구글 줄스(Jules) 사용 해보기 - Gemini 2.5 Pro 기반, GitHub 연동 코딩 에이전트 체험기

- -

안녕하세요! 갓대희 입니다. :- )

오늘은 새로 구글에서 출시한 "줄스(Jules)"에 대해 써보려고 한다.

평소처럼 GitHub 이슈를 정리하던 중 구글에서 새로운 코딩 에이전트를 출시했다는 소식을 들었다.

"에이전트"가 내 레포지토리를 클론해서 독립적으로 작업을 처리하고 풀 리퀘스트까지 만들어주는 컨셉으로 많이 소개되고 있다.

국내에서는 아직 조용한것 같다.

그리고 Google AI 구독 혜택에 당당히 모습도 들어 냈다. 한번 사용해볼만하지 않을까?

2가지 관점에서 사용 해보려 한다.

1. 왜 국내에선 조용할까? 우리 나라에선 꽤나 조용한 편으로 존재를 모르는 사람들도 많다. 이런 부분도 이유가 있을까?

2. 개인적으로는 결국 언젠가 AI시장도 구글에 꽤나 점유율이 계속 올라갈 수 있으니 이런 구글의 제품들을 무료로 써볼 수 있을때 한번 사용해보는것도 좋을 것 같아 설치 및 사용해본 후기를 남기려 한다.

구글 줄스(Jules)란?

구글 줄스는 지난 12월 Google Labs에서 공개한 실험적인 코딩 에이전트다. 최근 정식 오픈을 한것으로 확인 된다.

줄스 개요 : https://jules.google/

줄스 공식 Docs : https://jules.google/docs

1. 출시 일정

- 2025년 8월 6일:

- 정식 베타 종료 및 일반 출시(GA, General Availability)

- 무료 베타에서 유료 티어 체계로 전환

- 베타 기간 동안 수천 명의 개발자가 수만 개의 작업 완료

- 14만 건 이상의 코드 개선사항이 공개적으로 공유됨

- 2025년 5월:

- 퍼블릭 베타(Public Beta) 시작

- Google I/O 개발자 컨퍼런스에서 공개

- 전 세계 사용자 대상 무료 베타 서비스 제공

- 하루 60개 작업 제한으로 베타 운영

- 2024년 12월:

- Google Labs에서 초기 발표 (실험적 프로젝트로 소개)

- 클로즈드 프리뷰 단계

2. 베타 vs 정식 버전 차이점

- 정식 출시 후 (2025년 8월 ~):

- 무료 플랜: 하루 15개 작업, 동시 3개 작업 제한

- Google AI Pro ($19.99/월): 5배 높은 제한

- Google AI Ultra ($124.99/월): 20배 높은 제한

- 베타 기간 (2025년 5월 ~ 8월):

- 완전 무료

- 하루 60개 작업 제한

- 기본 기능만 제공

3. 특징

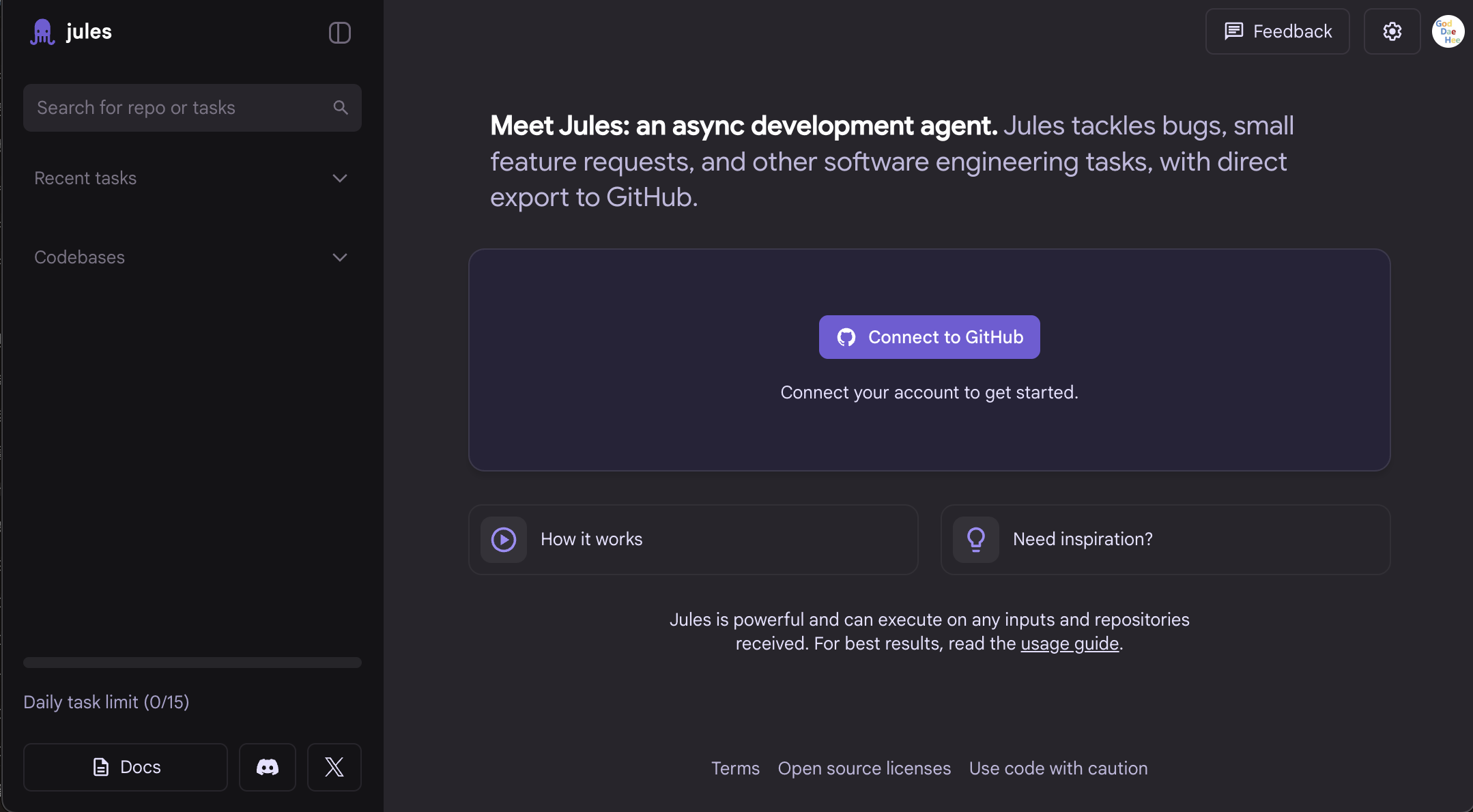

- 흔히 우리가 사용하던 IDE의 개념이 아니다. 웹에서 바로 사용 하는 컨셉 (요즘 이런 컨셉도 많이 출시되는 것 같다.)

- 웹 기반 대시보드 : jules.google.com에서 브라우저로 접속

- 독립된 웹 서비스 : VS Code나 IntelliJ 같은 코드 에디터와는 별개

- GitHub 연동 인터페이지 : 저장소 선택하고 작업 요청하는 웹 UI

- 결과 확인 대시보드 : 작업 진행상황과 완료된 PR을 확인하는 웹 페이지

- Gemini 2.5 Pro를 기반으로 하며, 내 코드베이스를 이해하고 비동기적으로 작업을 수행하는 AI 기반 코딩 어시스턴트이다.

- 비동기 코딩 에이전트라는 부분을 강조한다.

실시간 코드 어시스턴트가 아니라 비동기로 독립적인 작업을 수행하는 에이전트. VM에서 전체 프로젝트를 클론하고 완성된 풀 리퀘스트를 만들어주는 점이 가장 큰 차이점이라고 한다.

- GitHub 리포지토리를 안전한 클라우드 환경으로 복제하고 버그 수정, 버전 업데이트 또는 테스트 생성과 같은 작업을 실행할 수 있다. 코드베이스를 분석하고, 컨텍스트를 이해하며, 풀 리퀘스트를 통해 함께 일 할 수 있게 하여 주는데.

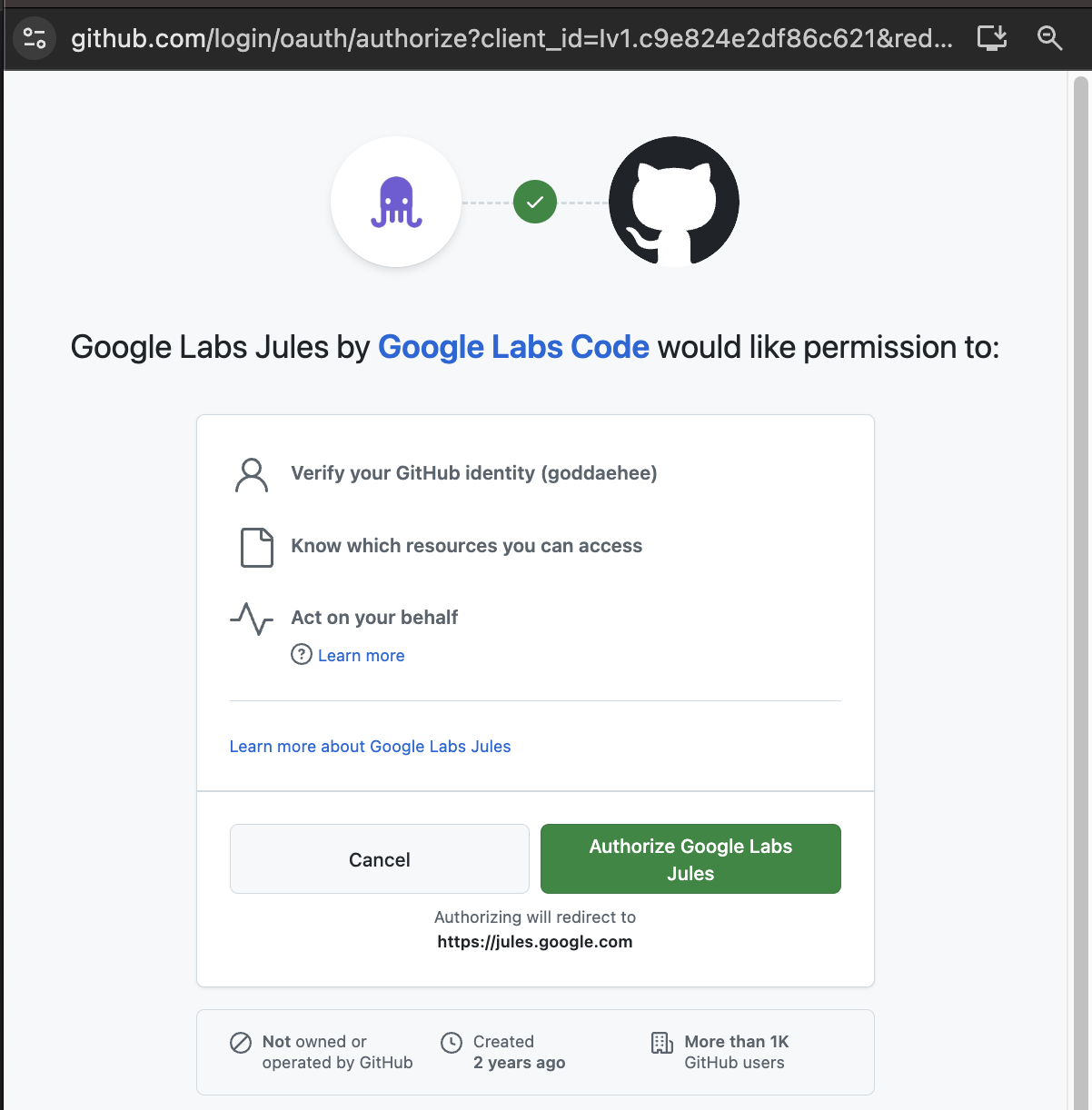

Github계정을 연동해야하는게 필수로 보인다??.

GitHub 연동 및 초기 설정

줄스를 사용하려면 먼저 GitHub 계정과 연동해야 한다. 설정 과정은 생각보다 간단했는데, 몇 가지 주의할 점이 있었다.

설정 과정

1. jules.google.com 접속 후 구글 계정으로 로그인한다. ( https://jules.google.com/ )

- 개인정보처리방침 동의 (일회성)

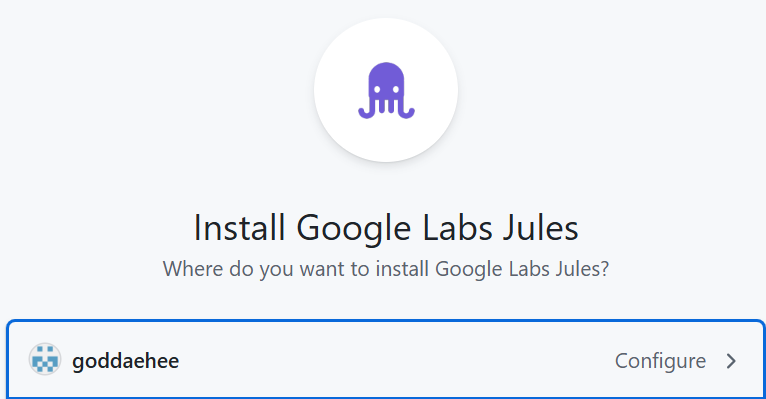

2. "Connect to GitHub" 버튼 클릭

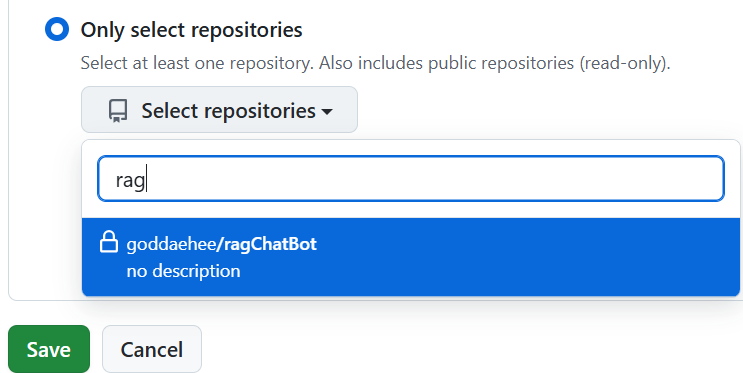

4. GitHub OAuth 승인 및 저장소 권한 설정

- 난 보수적으로 특정 Repository를 한개 지정 하도록 하겠다.

5. 줄스 대시보드로 리디렉션 확인

// 1. 처음에는 테스트용 저장소 1-2개만 선택

// 2. 개인 저장소부터 시작 (회사 코드는 찝찝하니..... 개인 저장보만 해보자.)

// 3. Public 저장소로 먼저 테스트해보기

// 권한 범위

- Repository access: Selected repositories (권장)

- Contents: Read and write

- Pull requests: Write

- Issues: Write (선택사항)

작업 시작하기

설정이 끝나면 대시보드에서 저장소 선택기와 프롬프트 입력 박스를 볼 수 있다.

테스트로 해당 프로젝트 (shrimp task manager MCP fork) 의 전체 개선방향을 찾아달라고 해보겠다.

- 하기 예시가 너무 명확하지 않은 포괄적인 내용의 프롬프트 이지만, 이렇게 막연히 시작도 해보자.

다만 이번 실습은 상기에 나와 있듯이 줄스의 특징이 비동기적으로 작업을 수행하는 것이 특징이라고 하니 복잡한 요청을 해보고, 알아서 혼자 작업을 잘하는지 살펴보는 취지에서 실습을 해보도록 하겠다.

프롬프트 예시 : 전체 개선 방향 제시를 요청 해봤다.

- ‘Shrimp Task Manager’ 프로젝트를 고려할 때, 사용성, 확장성, 및 AI 에이전트와의 상호작용을 개선하는 5가지 고영향력 개선 사항을 제안해줘.

Given the ‘Shrimp Task Manager’ project, propose 5 high-impact enhancements that improve usability, scalability, and AI-agent interaction.

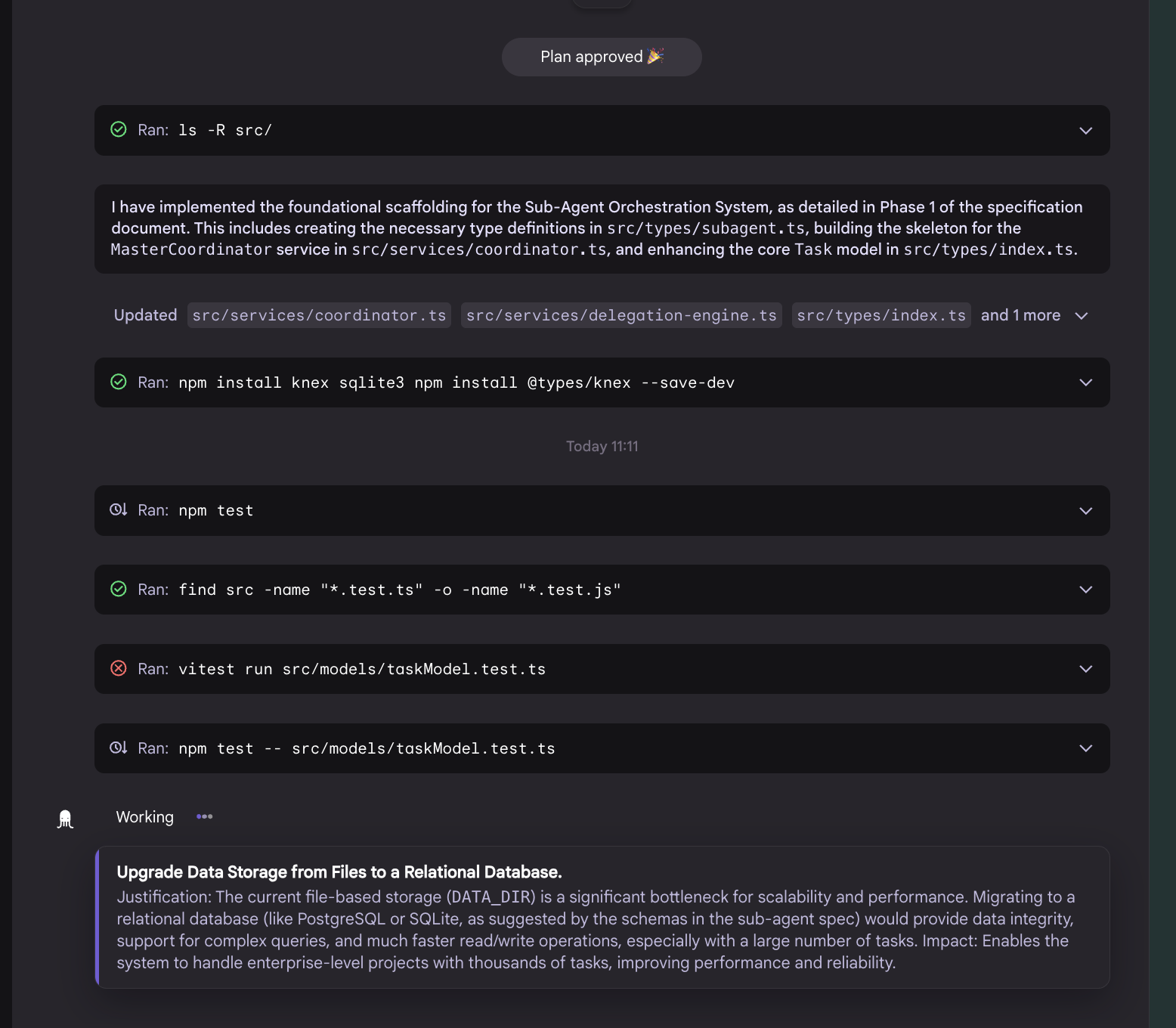

- 일을 하는 과정 > 실제 5가지 개선사항을 제한하는 것을 볼 수 있다.

- 첫번째 단계부터 바로 일을 시작한다.

- 우측패널에 변경, 생성한 소스도 계속 업데이트 되는 모습을 볼 수 있다.

- 정말 오랫동안 스스로 고치고, 결과물을 축적해 나간다. 점검하다가 중간에 한번 확인 요청을 하는 줄스의 모습.

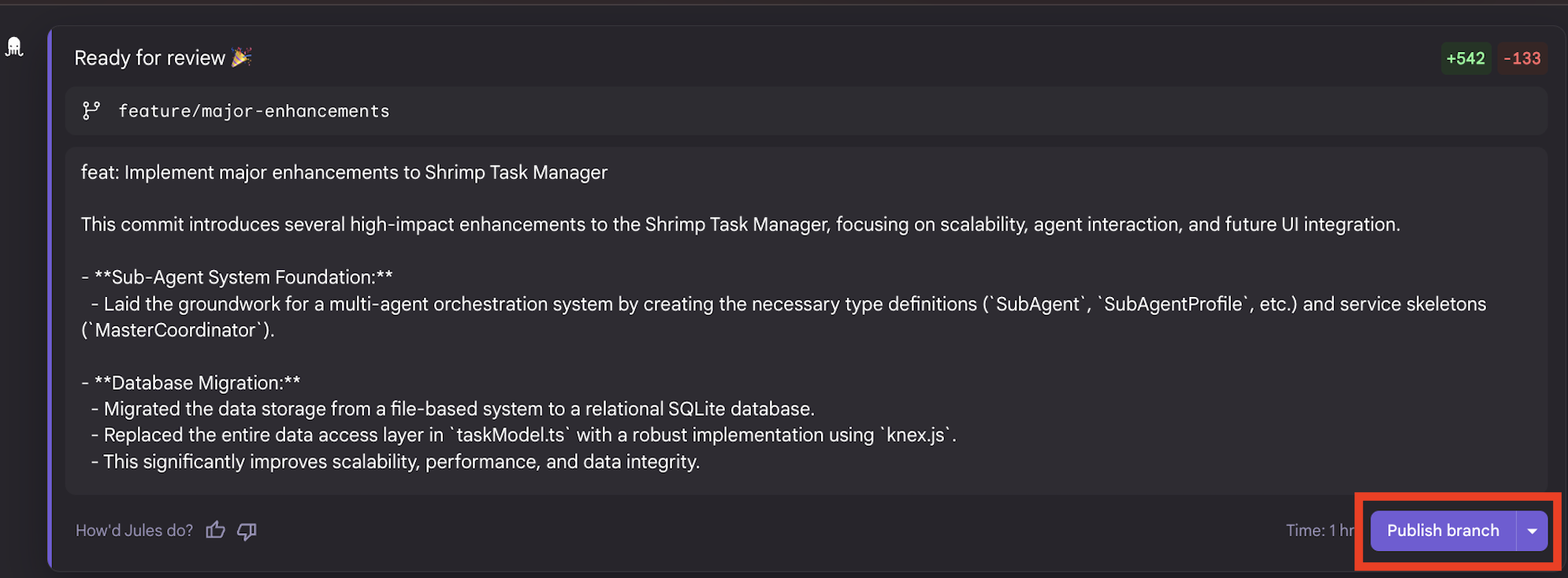

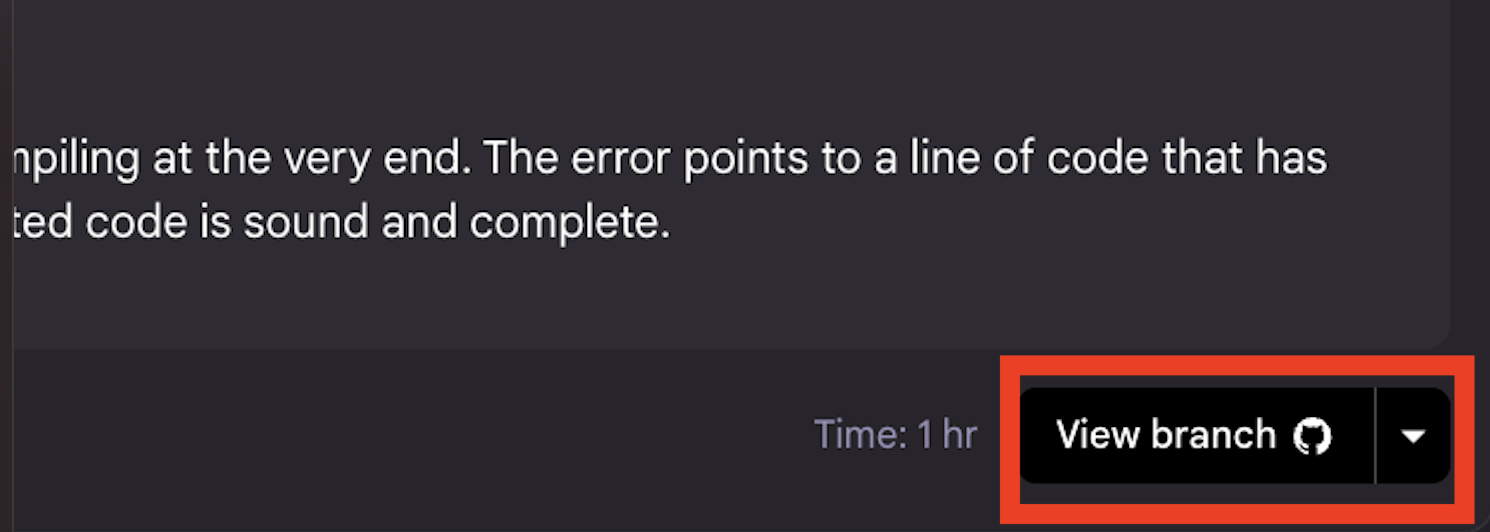

- 최종 결과 : 거의 한시간 정도 걸린것 같은데 혼자 알아서 일을 쭉 잘 한것 같다.

- 우측 패널에 작업 완료된 소스도 미리 볼 수 있다.

- 완성된 소스를 publish 해보도록 하겠다.

- 조금 기다리면 다음과 같이 버튼이 변경된다. 클릭하여 확인 해 보자.

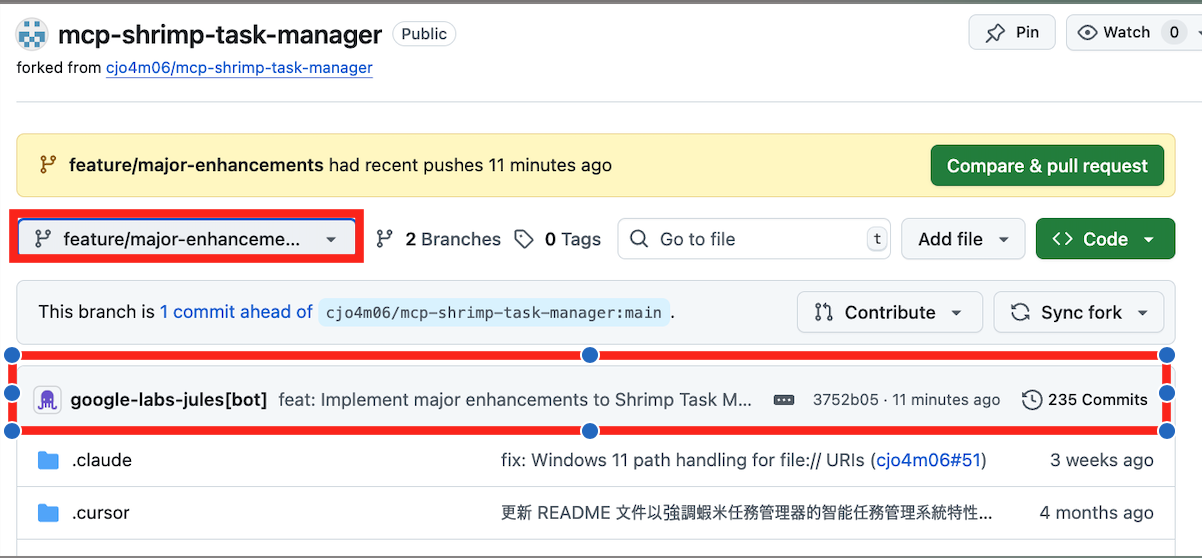

- jules가 알아서 신규 브랜치에 작업을 한 부분이 확인 된다.

- 커밋 메세지랑 커밋내역들 확인.

"Give me a plan" 버튼을 클릭하니 줄스가 작업 계획을 생성했다.

바로 코드를 생성하는 게 아니라 먼저 계획을 보여주고 승인을 받는다.

계획을 검토하고 승인하니 줄스가 본격적으로 작업을 시작했다.

브라우저 알림을 켜두었기 때문에 다른 일을 하다가도 진행 상황을 확인할 수 있었다.

3번정도 검토를 해주고, 난 브라우저만 켜두었는데 일이 다 끝나 있었다.

괜찮다는 앞으로 좀더 발전해 나가는 것을 보며, 이용해봐야겠다라는 생각이 들었다.

Gemini pro 2.5기준으로는 어느정도 일을 잘 할 것 같기도 하고,

업무 요청을 시킬 프롬프트를 상세히 잘 작성하면 좋은 결과물도 뽑아 낼 수 있을 것 같았다.

여기서 그만 보실 분들은 그만 보셔도 되고, 난 그럼 실제 내 프로젝트도 연동을 해서 작업을 시켜봐야겠다.

자세하게 잘 시키고, 중간 중간 추가 지시만 잘 하면 결과물이 기대되기도 한다.

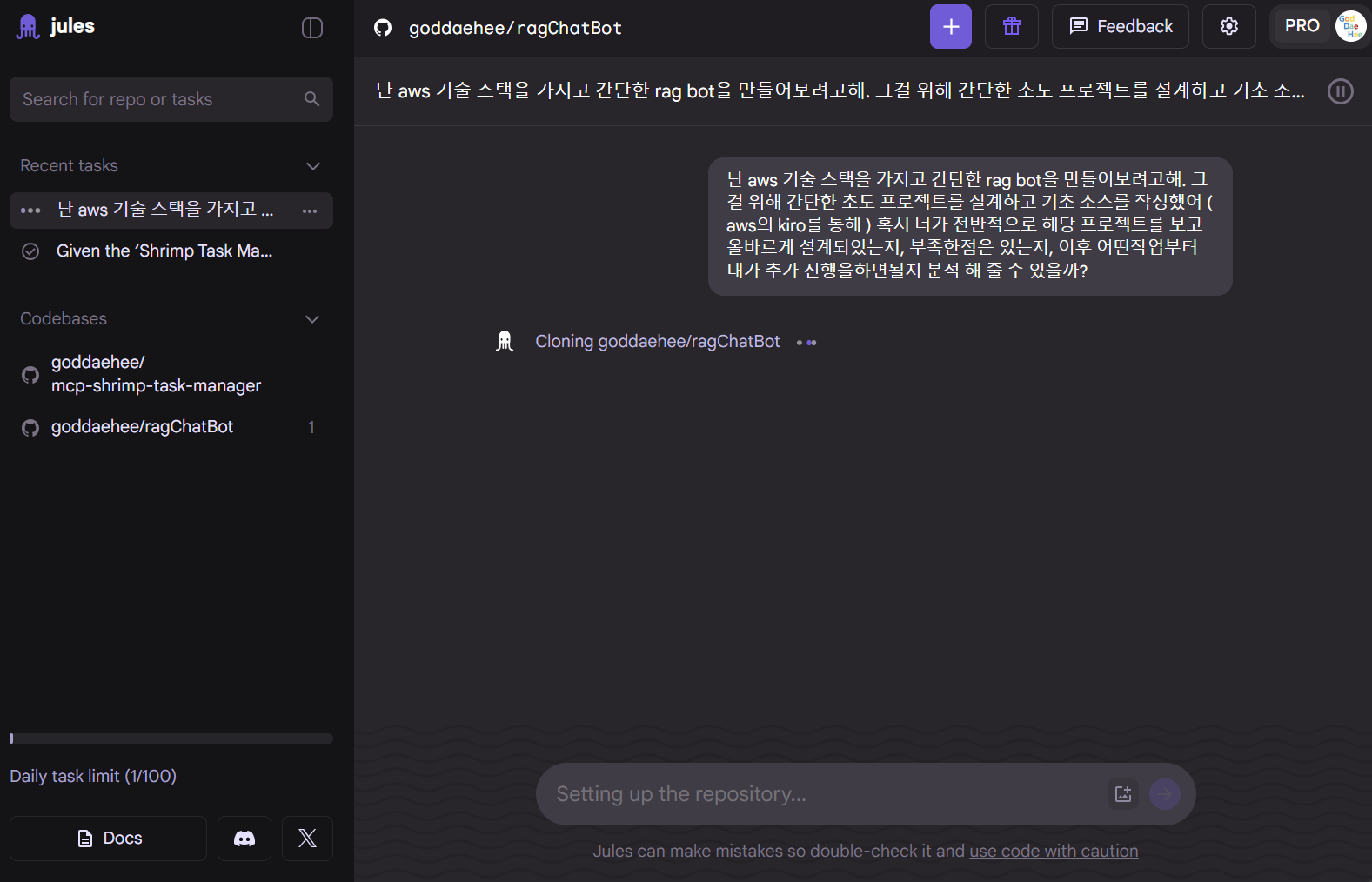

복잡한 기능 구현해보기

시간이 괜찮을때 조금더 실용적일고 복잡한 업무를 진행 해볼 예정이다. 해당 영역은 미완성. (추후 업데이트 예정)

리액트 프로젝트 내 피카츄 배구 게임 추가

일을 잘 실킬수 있는 프롬프트 준비.

- 작업할 Repository를 추가 해 주자.

- 나의 경우는 해당 repository 하나를 임의 지정 하였다.

- 방금 추가한 프로젝트를 선택하자.

- Design단계를 진행하라고 하는데 이미 난 초도 설계가 다 끝난 프로젝트이다. 혹시 다음과 같은 질문도 처리 가능한지 시도 해보겠다.

- 줄스님께서의 화답 내용이다. 전문은 소스 코드로 따로 작성해 두겠다.

이제 프로젝트의 모든 주요 파일을 검토했습니다. RAG_CHATBOT_SPECIFICATION.md, README.md, pyproject.toml, 그리고 핵심 로직이 담긴 rag_chatbot.py까지 모두 확인했습니다.

먼저, 이 프로젝트는 "간단한 초도 프로젝트" 수준을 훨씬 뛰어넘는, 매우 훌륭하고 완성도 높은 결과물이라는 점을 말씀드리고 싶습니다. 전문적인 소프트웨어 엔지니어의 관점에서 보아도 설계, 구현, 문서화 모든 면에서 뛰어납니다.

사용자님의 질문에 답변드리기 위해, 제가 분석한 내용을 바탕으로 전반적인 평가, 개선점, 그리고 다음 단계에 대한 제안을 드리겠습니다.

프로젝트 분석 및 평가

1. 설계 및 아키텍처 (매우 우수)

명확한 설계: RAG_CHATBOT_SPECIFICATION.md에 정의된 아키텍처는 RAG 시스템의 표준적인 모범 사례를 잘 따르고 있습니다. 문서 처리, 임베딩, 벡터 검색, 답변 생성에 이르는 파이프라인이 논리적으로 잘 구성되어 있습니다.

모듈성: rag_chatbot.py 파일 내에서 각 기능을 ConfigManager, DocumentProcessor, EmbeddingManager, VectorStoreManager, RAGChainManager 등 역할에 따라 클래스로 분리한 것은 매우 훌륭한 설계입니다. 비록 단일 파일이지만, 각 클래스가 독립적인 역할을 수행하여 코드의 이해와 유지보수를 용이하게 합니다.

확장성 고려: README.md와 코드 내에서 비용, 성능, 품질 등 다양한 사용 사례(use-case)에 따른 설정을 미리 정의해 둔 점은 PoC를 넘어 실제 운영 환경까지 고려한 깊이 있는 설계임을 보여줍니다.

2. 코드 품질 및 안정성 (매우 우수)

견고한 오류 처리: 제가 본 가장 인상적인 부분 중 하나는 AWSErrorHandler 클래스입니다. AWS 서비스에서 발생할 수 있는 거의 모든 일반적인 오류(자격 증명, 모델 접근, 네트워크 제한 등)에 대해 매우 상세하고 실질적인 해결책을 제시하고 있습니다. 이는 시스템의 안정성을 크게 높여줍니다.

상세한 로깅: 기능별 로거를 분리하고, 상세한 로그 메시지를 출력하여 문제 발생 시 원인을 추적하기 매우 용이하게 만들었습니다. --verbose 옵션은 디버깅에 큰 도움이 될 것입니다.

최신 개발 표준 준수: pyproject.toml을 통해 최신 Python 패키징 표준을 따르고 있으며, black, mypy 등 코드 포매팅 및 타입 체킹 도구를 설정한 것은 코드 품질에 대한 높은 기준을 보여줍니다.

자체 문서화된 코드: 모든 클래스와 주요 함수에 상세한 한글 주석(docstring)이 달려있어 코드 자체가 훌륭한 문서의 역할을 합니다.

3. 문서화 및 사용성 (매우 우수)

완벽한 문서: README.md 파일은 단순한 프로젝트 설명을 넘어, 설치, AWS 설정, 실행, 테스트, 문제 해결까지 모든 과정을 담고 있는 완벽한 사용자 매뉴얼입니다. Python 초보자도 따라 할 수 있도록 세심하게 작성된 점이 돋보입니다.

편리한 CLI: argparse를 활용한 명령줄 인터페이스는 테스트, 단일 질문, 상태 확인 등 다양한 모드를 지원하여 사용 및 개발 편의성을 크게 높였습니다.

부족한 점 및 개선 제안

현재 프로젝트는 PoC로서 부족한 점이 거의 없습니다. 다만, 이 프로젝트를 실제 서비스 수준으로 발전시킨다는 관점에서 다음과 같은 개선 방향을 제안할 수 있습니다.

프로젝트 구조화 (리팩토링)

현재: 모든 클래스가 rag_chatbot.py 단일 파일에 포함되어 있습니다.

개선 제안: 프로젝트가 더 커질 것을 대비하여, 각 클래스를 별도의 파일로 분리하는 것이 좋습니다. 예를 들어, src/rag_chatbot/ 디렉토리를 만들고 그 안에 config.py, document_processor.py, embedding.py 등으로 파일을 나누는 것입니다. 이는 Python 프로젝트의 표준적인 구조이며, 장기적인 유지보수와 협업에 유리합니다.

테스트 전략 고도화

현재: test_*.py 파일들을 통해 각 컴포넌트에 대한 훌륭한 통합 테스트 스크립트를 갖추고 있습니다.

개선 제안:

자동화된 테스트: pytest를 사용하여 모든 테스트를 한 번에 실행하고 결과를 리포트하도록 테스트 구조를 개선할 수 있습니다.

유닛 테스트 추가: 현재 테스트는 실제 AWS 서비스와 연동되는 통합 테스트입니다. unittest.mock과 같은 라이브러리를 사용하여 AWS 서비스 호출 부분을 모킹(mocking)하는 유닛 테스트를 추가하면, 네트워크나 AWS 상태와 무관하게 각 클래스의 로직을 빠르고 독립적으로 검증할 수 있습니다. 이는 개발 속도를 높이고 테스트 비용을 절감하는 데 도움이 됩니다.

배포 자동화 (Infrastructure as Code)

현재: README.md에 AWS 서비스(OpenSearch, IAM 등)를 수동으로 설정하는 방법이 안내되어 있습니다.

개선 제안: AWS CDK, Terraform, 또는 AWS CloudFormation과 같은 IaC(Infrastructure as Code) 도구를 사용하여 필요한 AWS 인프라를 코드로 정의하고 자동 배포하는 파이프라인을 구축할 수 있습니다. 이는 반복적인 배포를 빠르고 일관성 있게 만들어줍니다.

사용자 인터페이스(UI) 확장

현재: CLI(명령줄 인터페이스)를 제공합니다.

개선 제안: RAG 파이프라인 로직을 FastAPI나 Flask와 같은 웹 프레임워크를 사용하여 API로 감싸고, 간단한 웹 기반 채팅 UI를 구현하여 더 많은 사용자가 쉽게 접근할 수 있도록 만들 수 있습니다.

다음 작업 진행 순서 추천

분석한 내용을 바탕으로, 다음과 같은 순서로 작업을 진행하시는 것을 추천합니다.

1순위: 기존 테스트 실행 및 검증

가장 먼저 할 일은 작성된 test_*.py 스크립트들을 실제로 실행하여 현재 구현이 예상대로 완벽하게 동작하는지 검증하는 것입니다. README.md의 "테스트 및 검증 명령어" 섹션을 따라 모든 테스트를 수행하고, performance_results.json 같은 결과물을 확인해보세요. 이 과정을 통해 현재 코드베이스의 안정성을 완전히 신뢰할 수 있게 됩니다.

2순위: 프로젝트 구조 리팩토링

테스트를 통해 코드의 안정성을 확인했다면, 앞서 제안한 대로 rag_chatbot.py 파일을 여러 개의 파일로 분리하는 리팩토링을 진행하세요. 이는 앞으로의 기능 추가 및 코드 관리를 훨씬 수월하게 만들어 줄 것입니다.

3순위: 유닛 테스트 추가

리팩토링 후, 각 클래스의 핵심 로직에 대한 유닛 테스트를 추가하여 테스트 스위트를 강화하세요. 이를 통해 향후 변경 사항이 기존 기능에 영향을 미치지 않는다는 것을 더 빠르고 확실하게 보장할 수 있습니다.

4순위: 기능 확장 (UI 또는 배포 자동화)

안정적인 코드베이스와 테스트 환경이 갖춰졌다면, 웹 UI를 추가하거나 IaC를 통한 배포 자동화를 구축하는 등 새로운 기능 확장을 고려해볼 수 있습니다.

결론적으로, 이 프로젝트는 이미 매우 높은 수준의 완성도를 갖추고 있으며, 훌륭한 기반 위에 서 있습니다. 제가 제안드린 내용들은 이 멋진 PoC를 더욱 견고하고 확장 가능한 프로덕션급 애플리케이션으로 발전시키기 위한 다음 단계에 해당합니다.

혹시 추가적으로 궁금한 점이나 특정 부분에 대한 더 깊이 있는 분석이 필요하시면 언제든지 말씀해주세요.

- 제안 내용을 수락하여 (3번 제외) 진행 요청

- 꽤 오래 작업하고 검토 후 완료되었고, 해당 변경 사항을 pr 요청 해 보았다.

- 혹시나 gemini처럼 소스 리뷰가 가능한지 살펴보았는데, 아주 간단하게 리뷰 해준다..

AGENTS.md 파일 활용하기 📋

줄스를 더 효율적으로 사용하는 방법을 찾던 중 AGENTS.md 파일이라는 걸 발견했다. 프로젝트 루트에 이 파일을 만들어두면 줄스가 자동으로 읽어서 프로젝트 컨텍스트를 더 잘 이해한다고 한다.

# Project: E-commerce Dashboard

## Tech Stack

- Frontend: React 18 + TypeScript

- Backend: Express.js + Node.js

- Database: MongoDB + Mongoose

- Testing: Jest + React Testing Library

- Styling: Tailwind CSS

## Coding Standards

- ESLint + Prettier 사용

- 함수명은 camelCase

- 컴포넌트명은 PascalCase

- API 엔드포인트는 RESTful 방식

- 모든 함수에 JSDoc 주석 필수

## Project Structure

- src/

- components/ # 재사용 가능한 컴포넌트

- pages/ # 페이지 컴포넌트

- hooks/ # 커스텀 훅

- api/ # API 유틸리티

- utils/ # 헬퍼 함수

## Environment

- Node.js 18+

- MongoDB 6.0+

- 포트: 3000 (프론트), 5000 (백엔드)

AGENTS.md 파일을 추가한 후로는 줄스가 내 프로젝트 구조와 코딩 스타일을 훨씬 잘 이해했다. 파일 위치도 제대로 잡고, ESLint 규칙도 정확히 따르고, import 경로도 프로젝트 구조에 맞게 작성했다.

배운 점 정리

- 명확한 요구사항이 핵심: 막연한 프롬프트보다는 구체적인 요구사항과 제약 조건을 명시하는 게 중요했다

- AGENTS.md 파일의 위력: 프로젝트 컨텍스트를 미리 정의해두면 작업 품질이 확연히 향상된다

- 점진적 접근법: 복잡한 기능을 한 번에 구현하려 하지 말고 작은 단위로 나누어 진행하는 게 효율적이다

- 비동기 작업의 장점: 줄스가 작업하는 동안 다른 업무를 병행할 수 있어 전체적인 생산성이 크게 향상됐다

- 코드 리뷰 필수: AI가 만든 코드라도 반드시 검토하고 테스트한 후 머지해야 한다

참고 자료

- 구글 줄스 공식 사이트 - 가입 및 사용 가이드

- 공식 문서 - 상세한 기능 설명과 튜토리얼

- 줄스 Awesome Prompts - 실제 사용 사례와 프롬프트 예시

- 구글 공식 블로그 - 줄스 출시 소식과 비전

자주 묻는 질문 ❓

'AI > IDE 상황실' 카테고리의 다른 글

| Kiro 사용방법(2) - Kiro Agent Hooks, Steering 설정 예시(Agent Hooks, Steering 설정 방법 with RAG 개발 환경 구축) (2) | 2025.09.23 |

|---|---|

| Kiro 사용방법(1) - Kiro 스펙 기반 개발 방법(Spec Driven Development(SDD)) 사용 해보기(with RAG 개발 환경 구축) (2) | 2025.09.17 |

| 아마존 키로(Kiro) 설치방법 및 사용방법 (13) | 2025.07.29 |

| [커서(Cursor AI)] 최적의 Cursor AI 설정을 찾아보자 (with React) (7) | 2025.06.20 |

| [커서(Cursor AI)] Cursor 설치 및 기본 설정 가이드 [AI 코드 편집기 사용기] (6) | 2025.06.19 |

당신이 좋아할만한 콘텐츠

-

Kiro 사용방법(2) - Kiro Agent Hooks, Steering 설정 예시(Agent Hooks, Steering 설정 방법 with RAG 개발 환경 구축) 2025.09.23

-

Kiro 사용방법(1) - Kiro 스펙 기반 개발 방법(Spec Driven Development(SDD)) 사용 해보기(with RAG 개발 환경 구축) 2025.09.17

-

아마존 키로(Kiro) 설치방법 및 사용방법 2025.07.29

-

[커서(Cursor AI)] 최적의 Cursor AI 설정을 찾아보자 (with React) 2025.06.20

소중한 공감 감사합니다